本文最后更新于181 天前,其中的信息可能已经过时,如有错误请发送邮件到big_fw@foxmail.com

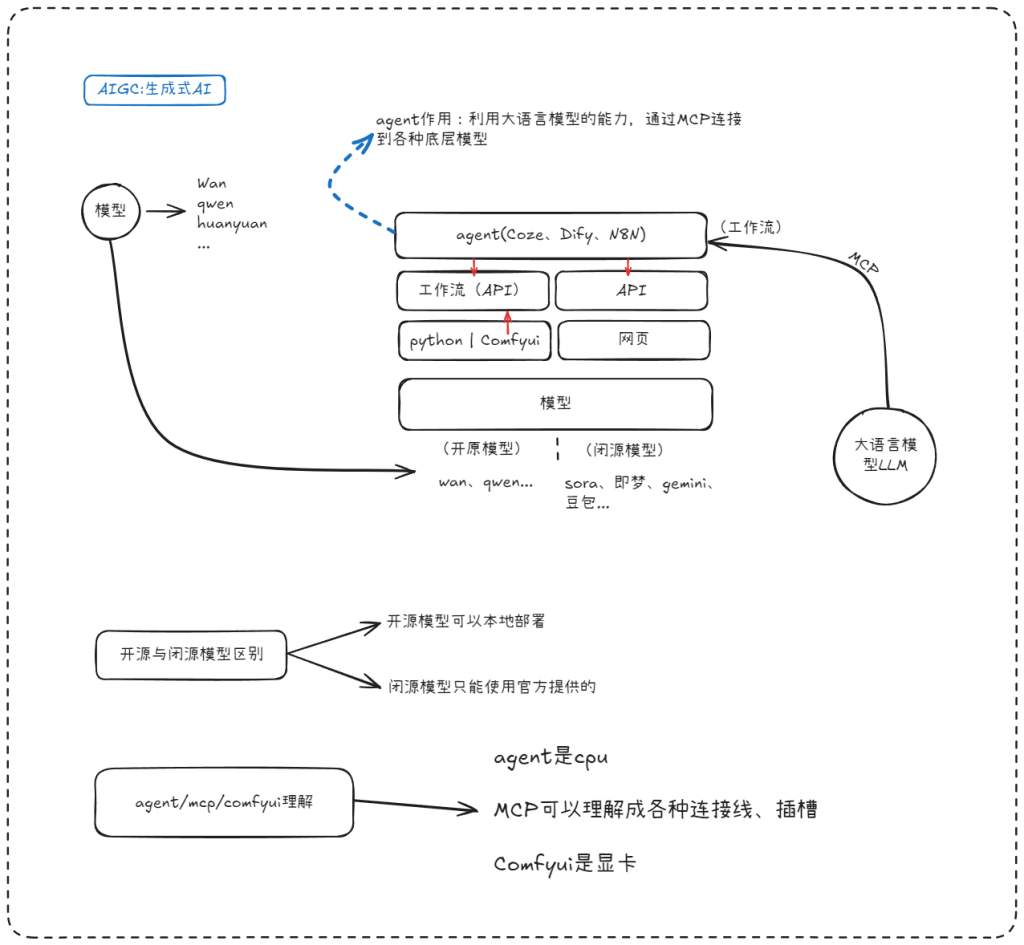

1. AIGC 概述

1.1 生成式AI定义

AIGC(Artificial Intelligence Generated Content)即生成式人工智能,是指利用人工智能技术自动生成文本、图像、音频、视频等内容的技术。

1.2 核心价值

利用大语言模型的能力,通过MCP连接到各种底层模型,实现内容的智能化生成。

1.3 AIGC技术栈与组件关系图

2. 模型分类与部署

2.1 开源模型

2.1.1 主流开源模型介绍

- Wan(万模型)

- Qwen(通义千问)

- Hunyuan(混元)

- 其他开源模型

2.1.2 开源模型部署方式

# 开源模型支持本地部署

# 示例:本地部署Qwen模型

python deploy_qwen_local.py --model_path ./qwen-7b2.2 闭源模型

2.2.1 主流闭源模型介绍

- Sora(OpenAI视频生成模型)

- 即梦(国内图像生成模型)

- Gemini(Google多模态模型)

- 豆包(字节跳动对话模型)

2.2.2 闭源模型使用限制

闭源模型只能通过官方提供的API接口进行调用,无法本地部署。

2.3 开源与闭源模型区别

2.3.1 部署方式差异

- 开源模型:支持本地化部署

- 闭源模型:仅限云端API调用

2.3.2 可控性对比

- 开源模型:完全可控,可自定义修改

- 闭源模型:受限于服务商规则

3. 技术架构组件

3.1 Agent平台

3.1.1 主流Agent平台

- Coze

- Dify

- N8N

3.1.2 Agent核心作用

Agent作为系统的”CPU”,负责协调和管理整个AI工作流程,利用大语言模型的能力调度各种底层模型。

3.2 MCP(模型控制平台)

3.2.1 MCP功能定位

MCP可以理解为各种连接线和插槽,负责不同模型之间的连接和通信。

3.2.2 连接管理

# MCP连接配置示例

mcp_connect:

source: "qwen_model"

target: "comfyui_processor"

protocol: "http"

timeout: 303.3 ComfyUI

3.3.1 功能特性

ComfyUI作为系统的”显卡”,专门负责处理图形相关的AI任务,特别是图像生成和编辑。

3.3.2 工作流程配置

# ComfyUI工作流配置示例

{

"workflow": "image_generation",

"model": "stable_diffusion",

"parameters": {

"prompt": "用户输入文本",

"steps": 20

}

}4. 接入方式与工作流

4.1 多种接入方式

4.1.1 Python SDK接入

# Python调用示例

import ai_client

client = ai_client.AIClient(api_key="your_key")

response = client.generate_text(prompt="你好")4.1.2 ComfyUI可视化界面

通过Web界面进行拖拽式工作流设计和模型调用。

4.1.3 网页端接入

提供React/Vue组件,便于前端集成。

4.1.4 API直接调用

# RESTful API调用示例

curl -X POST "https://api.aigc.com/v1/generate" \

-H "Authorization: Bearer {token}" \

-H "Content-Type: application/json" \

-d '{"model": "qwen", "prompt": "写一首诗"}'4.2 工作流管理

4.2.1 API工作流设计

通过API将多个模型和服务串联成完整的工作流程。

4.2.2 自动化流程

支持条件判断、循环执行、异常处理等复杂逻辑。

5. 系统架构总结

5.1 组件协作关系

Agent(CPU)→ MCP(连接线)→ 各类模型 → ComfyUI(显卡)

5.2 技术优势

- 模块化设计,易于扩展

- 支持多模型混合使用

- 提供多种接入方式

- 灵活的工作流配置